政府早前推出智慧都市藍圖,計劃在全港多個地方設立智慧橙柱,橙柱上的鏡頭惹來「人臉識別」的爭議。事實上,現代人生活在鏡頭之下,彷彿已成為社會的新常態。而現在,這些鏡頭不僅僅可以識別人的身分,更連結起龐大的數據庫,讓人工智能在背後悄然運行,將每一張臉的「快樂」、「苦惱」、「憤怒」變成數據進行分析研究。其實表情識別技術早已應用在商業、職場以及教育上,以改善營商策略、人才招聘和提升老師的教學效能。鏡頭讀心,不是遙遠的事。

記者│林怡欣 編輯│梁穎君 攝影│梁穎君 美術│黃雅詩

人可以依靠生活經驗,學習辨認不同的事物。人工智能沒有自主的生活經驗,要為它創造「記憶」,讓它「深度學習」,它才可以讀懂表情。

以辨認笑容為例,只要向系統輸入約一萬張不同的微笑照片,系統便會分析微笑時五官的角度、面部肌肉線條等等,歸納出微笑的共同特徵,當出現下一張擁有這些特徵的圖片時,就能根據過往經驗所得,像人一樣懂得判斷某人在微笑。因此,要提高人工智能辨別表情的準確度,需要龐大的圖片庫,分辨不同種族、性別、外型和外貌的人。

現時全球有多間大學、科研中心等搜集和分析過百萬張人臉照片,建立人臉數據庫。本地亦有初創企業利用這些數據庫,在人力資源、零售和教育方面推出不同產品。

視像面試日趨普及 求職第一步

一些大企業,如國泰航空、新世界集團、摩根大通(香港)等,近年在招聘一些熱門職位如空中服務員、管理實習生時,都會利用視像面試作首輪篩選。求職者不需親臨公司,只要拿起手機,就可以隨時隨地進行視像面試。

本港首個網上面試平台VCruit運用了微軟公司提供的人臉數據庫,為上市地產發展商、獵頭公司、大學職訓中心等提供視像面試服務,求職者只需要下載VCruit的應用程式,面向手機自拍鏡頭,在限時內回答屏幕出現的問題後上傳影片,便可完成第一輪的面試,整個過程不消30分鐘。

VCruit應用程式創辦人李卓堯指,片段將會分拆成一秒一幀的圖片,利用人工智能來分析求職者的面部表情,例如微笑、大笑、皺眉、哭泣等,分別歸納成「正面」、「負面」或「中性」三大類,各得出一個百分比,以顯示求職者在面試時的表現,而公司一般傾向聘請表情較為正面的人。

以初創公司為例,他們希望聘請到不怕失敗,願意不停作出嘗試的員工來負責新項目,所以會把正面表情的佔分提高,或按負面表情比例作出扣分。他指,以100個應徵者為例,系統只需約24小時完成錄像分析和製作報告,經篩選後再作第二輪真人面試,比起傳統的面試方式需要近兩星期才處理完第一輪面試快了很多。

求職平台OnGrad創辦人蘇俊軒指,視像面試受僱主和求職者的青睞有幾點原因。在企業方面,礙於人力和時間有限,所以處理大量求職申請時只會根據履歷上的大學排名和成績,篩選出來自名牌大學或有優秀成績的學生進行面試。企業其實意識到這樣會篩掉一些學歷雖然不夠亮眼但有潛質的人。有了人工智能的視像面試後,所有人都可以有一次面試的機會,令學歷不會成為篩選的唯一指標,使取錄機制更公平。

而在求職者方面,視像面試令他們不用受限於時間和地點,為他們帶來了很大的便利。蘇俊軒指:「有求職者反映,雖然說面試只進行一小時,但加上交通來回的時間可能要用上三小時,現在從電話下載應用程式,可以隨時隨地進行面試。」

分析表情 了解顧客體驗

除了招聘過程外,有初創公司更把表情識別技術運用在零售業務上。本地初創企業DayTa研發了一款可以分析客人情感的軟件Cyclops,利用店鋪已有的閉路電視,獲取客人使用服務時的片段,然後透過人工智能分析客人表情,歸類成「滿意」、「不滿意」、「驚喜」或「憤怒」等情緒。

香港目前有二十多個品牌使用Cyclops,當中不乏大型連鎖服裝品牌。DayTa創辦人屠厚鈞指,以往服務質素和客人的體驗難以被量化,因此分析表情至少可以提供多一個指標來了解店鋪內的情況。他指,如果在排隊付款的區域偵測到很多「憤怒」的表情,或就證明顧客久候不耐,此時,店主或需適當增加人手。

了解顧客體驗並非新鮮事,香港很多商鋪都會在收銀處擺放意見收集箱收集意見。屠厚鈞指這些意見書的回應率很低:「十個人經過十個都不會填寫,即使商店想了解,但他們從來都不會收集到。」他指箇中原因是客人在購物時不會希望整個購物體驗被打斷,結賬時亦很著重效率,所以不會主動參與服務調查。但有了鏡頭和人工智能,商店就可以在不干擾客人購物的情況下收集數據。

學校試用 觀察學生表情變化

香港有不少中小學採用平板電腦教學,有教育軟件公司推出學習應用程式,利用平板電腦的鏡頭,分析學生做練習時的表情,整理出一份含有情緒資訊的報告,供老師了解學生答題時的情緒,從而更全面分析學生表現,以調整教學內容。

香港真光書院去年讓應屆資訊及科技科考生試用了該套教學軟件。副校長朱嘉添指,未能看到情緒和成績明顯的關係,以及情緒分析如何能提高學習效能。他解釋,得分低的學生在作答題目時,不一定全程都表現得沮喪。成績基本上可以反映學生是否學懂,未必需要了解當刻情緒。不過,應用程式除了表情識別外,以遊戲形式結合訓練題目比傳統以紙筆操練更吸引,所以他與技術供應商反映了試用心得後,今年將再次試用該教學系統。

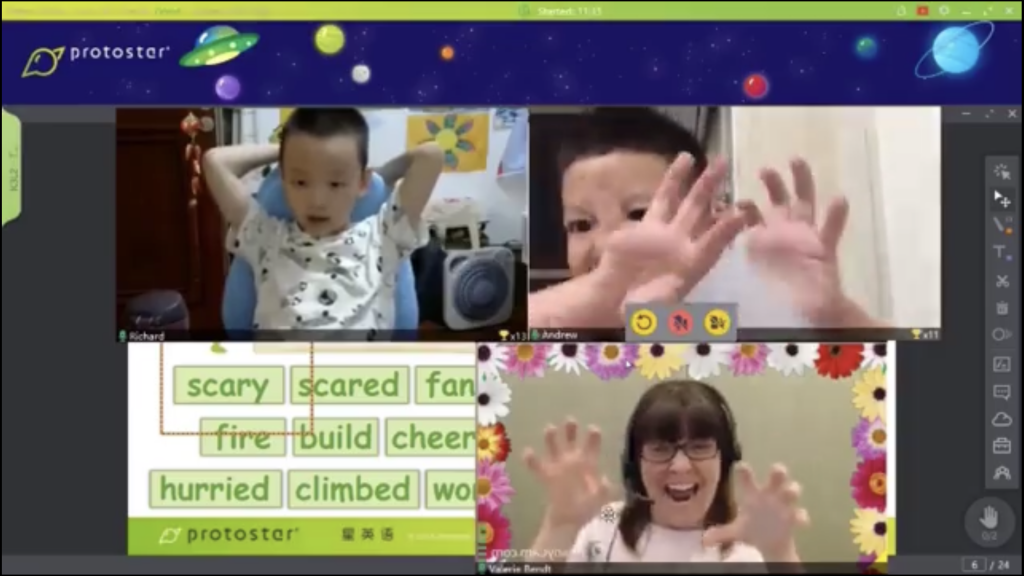

表情識別不單進入學校,甚至亦在補習社萌芽。近年,愈來愈多家長希望聘請英文母語的外籍老師替子女補習英文。博星教育便是一個聘請外地英語老師,以電腦或平板電腦進行視像對話的形式,提供線上教學的補習平台。為了更好地監察學生的課堂表現,鏡頭會錄下課堂情況,公司及後安排人手翻看學生上課狀態,再定期和家長會面,檢討學生表現。但人手翻看影片非常費時,為了提升效率,創辦人陳如宏指,他們正研發軟件及建立針對學生學習的表情數據庫,以分析學生上課時的表情,節省真人觀看錄影的時間。

識別表情 不泄人物身分

表情識別和備受爭議的人臉識別不同。人臉識別系統擁有個人的面部特徵數據,與鏡頭影像配對,從而辨認出個人身分。而表情識別技術則只會分析鏡頭攝錄的影像的表情,沒有個人資料庫進行配對,不會辨認出個人身分,所以私隱爭議較少。

雖然人工智能在不同層面提供了很大的便利,但它始終不能完全取代人手。蘇俊軒認為,視像面試限制了僱主和求職者的互相了解。對僱主而言,雖然錄像面試能幫助公司客觀地篩選出一部分人,但除了表情以外,例如衣著儀容整潔與否、坐姿是否恰當等,均需求職者親臨面試才可以即場看到。而對求職者來說,面試過程亦提供機會讓他們感受公司的工作環境、同事、工作氣氛等,思考自己是否適合這間公司。他相信愈早到場互相了解可以愈早知道大家是否適合,不用到最後花了很多時間才發現並不符合自己的理想。

陳如宏和朱嘉添亦同樣認為,即使有了表情識別系統,但老師的參與仍然是必需的。該系統雖可分擔老師工作,進行高效率的數據分析,但與學生溝通,從中啟發學生思考,或與家長建立合作關係,一同了解和配合學生的學習需要,仍需依靠老師親身參與其中。